KI auf dem eigenen Rechner: Warum du jetzt die Kontrolle zurückgewinnen solltest

Warum der Wechsel zu lokaler KI jetzt der richtige Schritt ist.

Während alle Welt über ChatGPT und die Cloud-Giganten spricht, passiert etwas Erstaunliches: Immer mehr Menschen und Unternehmen holen ihre Künstliche Intelligenz zurück – auf den eigenen Laptop, das Smartphone oder den Firmenserver. Was nach Retro-Trend klingt, ist in Wahrheit eine technologische Revolution mit handfesten Vorteilen. Denn lokale KI-Modelle sind längst keine Spielerei mehr für Nerds, sondern eine echte Alternative, die dir Datenschutz, Kostenkontrolle und Unabhängigkeit zurückgibt. Erfahre hier, warum dieser Wandel gerade jetzt so spannend ist – und wie du selbst davon profitieren kannst.

Deine Daten bleiben, wo sie hingehören: bei dir

Der wohl überzeugendste Grund für lokale KI ist die Datensouveränität. Jedes Mal, wenn du ChatGPT oder ähnliche Dienste nutzt, wandern deine Anfragen auf fremde Server – oft in die USA, manchmal in eine regelrechte Black Box. Was dort mit deinen Informationen passiert, bleibt unklar.

Keine Lecks, kein Risiko

Bei einer lokalen Lösung verlassen sensible Daten niemals dein Gerät. Vertrauliche Firmendokumente, private Fotos oder persönliche Notizen bleiben genau dort, wo sie hingehören: auf deiner Hardware. Das Risiko von Datenlecks oder unbefugten Zugriffen durch Dritte wird damit praktisch auf null reduziert.

DSGVO ohne Kopfschmerzen

Gerade für europäische Unternehmen ist das Gold wert. Ohne Datenübertragung in die USA wird die Einhaltung der Datenschutzgrundverordnung zum Kinderspiel. Keine komplizierten Standardvertragsklauseln, keine Sorge um die nächste Gerichtsentscheidung zum Datentransfer.

Unabhängigkeit von den Tech-Giganten

Wer vollständig auf Cloud-Dienste setzt, macht sich abhängig – von Preisänderungen, AGB-Anpassungen und der Geschäftspolitik der großen Anbieter. Mit lokaler KI gewinnst du nicht nur technische Kontrolle zurück, sondern behältst auch die Hoheit über geschäftskritische Erkenntnisse und Prozesse.

Hardware-Mythen entlarvt: Du brauchst kein Rechenzentrum

Viele denken bei lokaler KI sofort an teure Serverschränke im Keller. Die Realität sieht deutlich entspannter aus – es kommt nur auf das richtige Modell an.

So klein kann ein KI Rechner sein. Elon Musk hält Nvidia DGX Spark in den Händen.

Der entscheidende Faktor: VRAM

Für flüssige, schnelle Antworten ist der Grafikspeicher (VRAM) deiner Grafikkarte der Schlüssel. Eine High-End-Karte wie die RTX 5090 gilt in der KI-Community als leistungsstark, für gigantische Modelle mit über 600 Milliarden Parametern reicht aber selbst sie nicht aus. Die gute Nachricht: Du brauchst diese Monster-Modelle für die meisten Aufgaben gar nicht.

Was du wirklich nutzen kannst

Auf dem Smartphone: Es gibt mittlerweile Modelle wie Ministral 3B oder PocketPal, die direkt auf deinem Handy laufen. Komplett offline, überraschend leistungsfähig bei Mathematik und einfachen Aufgaben – perfekt für unterwegs.

Gaming-PC oder Laptop: Ein moderner Rechner mit einer Grafikkarte ab 24 GB VRAM kann bereits sehr leistungsstarke Modelle wie Ministral 14B schnell und flüssig ausführen. Für viele Anwendungsfälle reicht das völlig aus.

RAM als Alternative: Willst du die ganz großen Modelle wie DeepseekV3.1 nutzen, die auf GPT-Niveau arbeiten? Dann kannst du auf deinen normalen Arbeitsspeicher ausweichen. Mit 128 GB oder 256 GB RAM ist das machbar – allerdings wird die Geschwindigkeit deutlich langsamer (nur wenige Wörter pro Sekunde statt flüssiger Dialoge).

Die neue Messlatte: Intelligenz pro Watt

Lange galt die Überzeugung: Nur riesige Rechenzentren liefern echte KI-Power. Doch neue Forschungen – unter anderem aus Stanford – zeigen einen fundamentalen Wandel. Die entscheidende Kennzahl heißt heute "Intelligenz pro Watt".

Der Effizienzsprung ist real

Die Kosten für KI-Inferenz, also die tatsächliche Anwendung eines Modells, sind in nur zwei Jahren um das bis zu 280-Fache gesunken. Das ist keine kleine Verbesserung – das ist eine Revolution in der Wirtschaftlichkeit.

Energiebilanz mit Überraschungseffekt

Eine einzelne ChatGPT-Anfrage verbraucht etwa zehnmal so viel Energie wie eine Google-Suche. Lokale Modelle können diesen Verbrauch drastisch senken, was nicht nur deine Stromrechnung schont, sondern auch Nachhaltigkeitsziele unterstützt.

Wann rechnet sich eigene Hardware?

Für Unternehmen mit hohem Anfragevolumen kann sich die Investition in eigene Hardware bereits nach 3 bis 12 Monaten amortisieren. Auch wenn du eigene KI-Workflows in deinem Unternehmen umsetzen möchtest, ist die lokale Nutzungs meist sinnvoller. Denn: Je mehr du die KI nutzt, desto günstiger wird es.

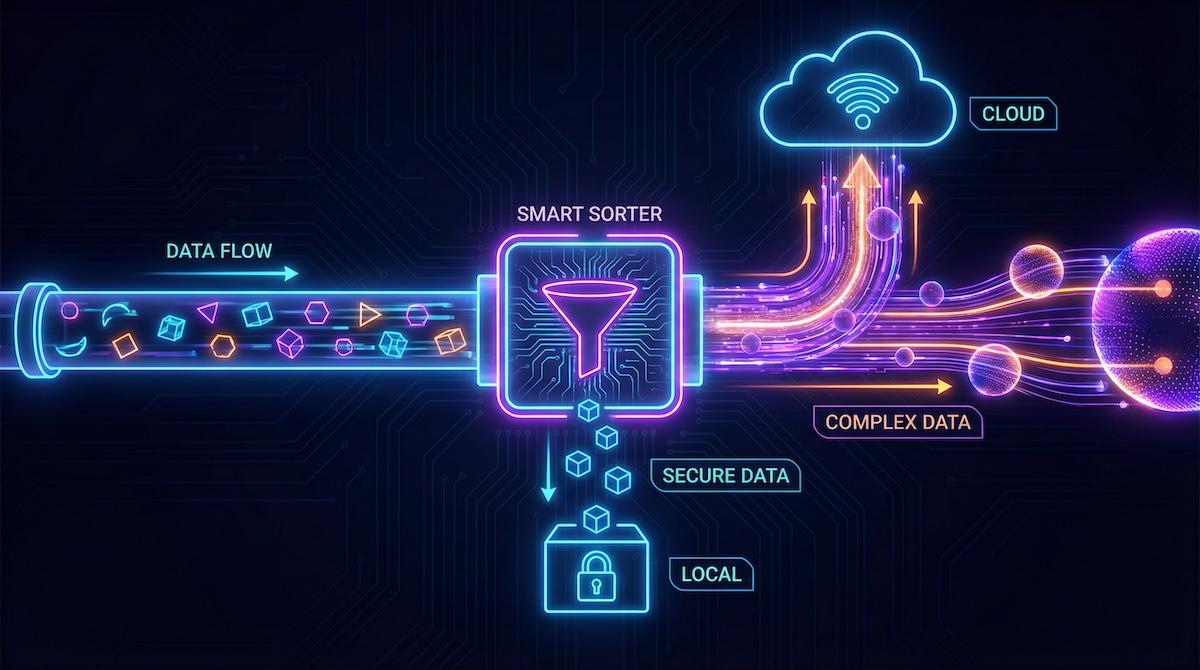

Hybrid ist die Zukunft: Nutze beide Welten intelligent

Experten sind sich einig: Es muss nicht "Entweder-oder" heißen. Die klügste Strategie ist hybrid. Dabei entscheidet ein intelligentes Routing-System automatisch, wohin deine Anfrage geht:

Ein intelligentes System entscheided, ob Daten in der Cloud oder lokal verarbeitet werden.

Lokal für den Alltag

Sensible Daten, Echtzeit-Anforderungen (etwa in der Produktion oder bei der Bilderkennung) und Routineaufgaben werden kostengünstig auf deiner eigenen Hardware erledigt. Schnell, sicher und ohne laufende Kosten.

Cloud für die Spezialfälle

Nur wenn maximale Rechenpower oder enormes Weltwissen erforderlich ist, geht die Anfrage an einen Cloud-Dienst. Du nutzt die Stärken der großen Anbieter dann, wenn sie wirklich einen Mehrwert bringen.

Der wirtschaftliche Hebel

Selbst ein einfaches Routing-System, kann deine Gesamtkosten bereits um 45 Prozent senken. Bei optimierter Verteilung sind die Einsparungen noch deutlich höher.

Fazit: Vom Konsumenten zum Anwendungsweltmeister

Lokale KI ist kein Zukunftstraum mehr – sie ist heute einsatzbereit und beeindruckend leistungsfähig. Europäische Modelle wie Mistral beweisen, dass man auch ohne Big Tech aus den USA State-of-the-Art-Ergebnisse erzielen kann. Die Einrichtung mag auf den ersten Blick komplex wirken, aber Tools wie LM Studio, Ollama oder PocketPal machen es mittlerweile kinderleicht, Modelle herunterzuladen und zu starten.

Probier es aus: Lade dir ein lokales Modell herunter und teste es für eine Woche. Du wirst merken, wie gut es sich anfühlt, die Kontrolle zurückzuhaben. Du lernst nicht nur, wie die Technologie wirklich funktioniert – du gewinnst auch Unabhängigkeit, Sicherheit und ein tieferes Verständnis für eine der wichtigsten Technologien unserer Zeit. Vom reinen KI-Konsumenten zum souveränen Anwender: Dieser Schritt ist einfacher, als du denkst.