Private KI für Unternehmen: Die Ära der Corporate Large Language Models (Corporate LLMs)

Mit einem Corporate LLM bekommt jeder seinen persönlichen Workspace

Stell dir vor, du könntest ChatGPT nutzen – aber ohne monatliche Abos, ohne dass deine Daten in die USA fließen und ohne dass du dir Gedanken über DSGVO-Verstöße machen musst.

Private KI, auch als lokale oder Corporate Large Language Models (Corporate LLMs) bekannt, ermöglicht genau das!

Während Unternehmen weltweit noch nach sicheren KI-Lösungen suchen, liegt die Antwort bereits auf deinem eigenen Computer.

Und das Beste: Du benötigst dafür weder ein Informatikstudium noch ein riesiges Budget von mehreren zehntausend Euros.

250.000€ Umsatz als KI-Agentur – APEX setzt neue Maßstäbe im Markt. Gemeinsam mit dem Geschäftsführer und dem leitenden Ingenieur Jousef Murad steht das Team für technologische Exzellenz und skalierbare Systeme. Ein klares Signal für Dominanz, Innovation und nachhaltiges Wachstum.

Warum private KI jetzt unverzichtbar wird

Das Abo-Chaos hat ein Ende

Kennst du das Gefühl, den Überblick über deine KI-Abos zu verlieren? Jeden Monat ein neues Tool, eine neue Rechnung, ein neuer Login (als KI-Agentur kennen wir das - und es nervt)...Mit lokalen Large Language Models ist Schluss damit. Du lädst dir einmal das KI-Modell deiner Wahl herunter – völlig kostenlos – und lässt es auf deinem Computer laufen. Kein Abo, keine versteckten Kosten, keine Überraschungen am Monatsende.

Für Unternehmen wird die Rechnung noch eindrucksvoller: Der ChatGPT-Team-Plan kostet 25 Euro pro Monat und pro Nutzer. Bei 50 Mitarbeitern beläuft sich das auf 15.000 Euro jährlich. Bei 100 Mitarbeitern sind es bereits 30.000 Euro. Und bei 500 Mitarbeitern? Satte 150.000 Euro – für exakt dieselbe Software, nur mit individuellen Zugängen. Ein eigener Corporate-LLM-Workspace macht diese Kosten überflüssig. Unlimitiert viele Nutzer können kostenlos angelegt werden, alles läuft auf deiner eigenen Hardware.

Datenschutz ist keine Option mehr – es ist Pflicht

Jeder Prompt, den du bei ChatGPT eingibst, jede Frage, die du stellst, landet auf Servern von OpenAI in den USA. Auch wenn dir der Team-Plan zusichert, dass deine Daten nicht für das Modelltraining verwendet werden – sie verlassen trotzdem dein Unternehmen. Und genau hier wird es kritisch.

Die BaFin (Bundesanstalt für Finanzdienstleistungsaufsicht) macht lokale LLMs für Banken und Versicherungen praktisch zur Pflicht. Der EU AI Act verschärft die Anforderungen massiv: Bis zu 35 Millionen Euro Strafe oder 7 % des Jahresumsatzes drohen bei Verstößen. Deutsche Datenschutzbehörden bestätigen, dass nur lokale LLMs echte DSGVO-Konformität ohne komplexe Auftragsverarbeitungsverträge bieten.

Die unbequeme Wahrheit: Fast jedes Unternehmen, das einfach ChatGPT nutzt, bewegt sich bereits auf dünnem Eis.

Und dann ist da noch die Frage der Kundeneinwilligungen. Wie holst du von jedem Kunden und Interessenten die Erlaubnis ein, dass du ihre Daten in einen Cloud-Dienst eines US-Unternehmens lädst? Die meisten tun es nicht – und genau das ist das Problem.

„Was APEX auf die Beine stellt, spielt in einer ganz anderen Liga. Die Ergebnisse sind Weltklasse.“ – Tobias Frese, Geschäftsführer der Frese Recruiting GmbH

Der praktische Vorteil: Ein System für alle

Viele Unternehmen denken clever und erstellen einfach einen gemeinsamen ChatGPT-Account für alle Mitarbeiter. Das Problem: Dann nutzt niemand das System wirklich ernsthaft.

Alles wird unordentlich, Chats überschneiden sich, und echte Produktivitätssteigerung bleibt aus. Jeder Mitarbeiter braucht seinen eigenen Zugang – so simpel ist das.

Mit einem Corporate LLM bekommt jeder seinen persönlichen Workspace, der genauso aussieht wie ChatGPT.

Die Schulungen erfolgen über APEX, und es gibt nahezu keine Umgewöhnungsphase. Und das Beste: Alles bleibt in deinem Unternehmen!

„In nur drei Monaten Zusammenarbeit mit APEX haben wir mehr produziert als in der gesamten Geschichte von Navasto. Die Qualität war besser, als ich es selbst hätte hinbekommen – und das in weitaus kürzerer Zeit.“ – Matthias Bauer, Mitbegründer von Navasto

Was sind lokale LLMs eigentlich?

Die drei wichtigsten Begriffe im Überblick

Bevor wir tiefer einsteigen, lass uns kurz die Begriffe klären, die dir in diesem Bereich immer wieder begegnen werden:

Private KI ist der Oberbegriff für alle KI-Systeme, die auf deiner eigenen Hardware laufen. Statt deine Daten an OpenAI, Google oder andere Unternehmen zu schicken, läuft alles bei dir – in der Regel offline und komplett privat. Private KI ist das Gegenteil von Cloud-KI wie ChatGPT, die all deine Daten speichern und für unbekannte Zwecke nutzen dürfen.

Lokale LLMs sind Large Language Models (wie GPT), die komplett auf deinem Computer laufen – vollständig offline. Du lädst das Modell einmal herunter, und das war's. Danach brauchst du keine Internetverbindung mehr.

Self-hosted LLMs sind sehr ähnlich, laufen aber auf deinen eigenen Servern – nicht zwingend auf dem Rechner bei dir im Büro. Du kannst sie beispielsweise auf einem gemieteten Server bei Hetzner, AWS oder Azure betreiben. Wichtig ist: Du kontrollierst den Server komplett. Niemand außer dir hat Zugriff. Es ist also privat, aber nicht unbedingt lokal.

Corporate LLMs sind lokale oder self-hosted LLMs, die speziell für Unternehmen eingerichtet sind. Sie laufen auf eigenen Servern, haben eine zentrale Nutzerverwaltung, eigene KI-Agenten und sind oft mit den eigenen Unternehmensdaten trainiert. Die Profi-Version von privater KI für Unternehmen.

Der Restaurant-Vergleich

Um den Unterschied noch deutlicher zu machen: Cloud-KI wie ChatGPT ist wie ins Restaurant gehen. Du bestellst etwas (stellst eine Frage), der Koch bereitet es zu (ChatGPT antwortet), aber du hast keine Ahnung, was in der Küche passiert. Du musst bezahlen, musst warten, und das Restaurant merkt sich genau, was du bestellt hast. Wenn das Restaurant geschlossen oder überfüllt ist, bekommst du nichts.

Private KI mit lokalen LLMs ist wie dein eigener Koch zu Hause. Er kann die gleichen Gerichte wie im Restaurant zubereiten, aber er arbeitet nur für dich. Kein Warten, niemand außer dir weiß, was du isst. Du kaufst den Koch einmal ein, und dann kocht er für immer für dich.

Ein Corporate LLM ist wie eine komplette Firmenkantine mit mehreren Köchen. Jeder Mitarbeiter hat seinen eigenen Zugang. Alles läuft über deine eigenen Küchen, und du kannst sogar spezielle Rezepte entwickeln, die nur deine Firma kennt.

Dein erstes lokales LLM in wenigen Minuten

Ollama: Dein Einstieg in die private KI

Jetzt wird es praktisch. Das Tool der Wahl heißt Ollama – ein fantastisches, kostenloses Open-Source-Tool, mit dem du LLMs herunterladen, verwalten und auf deinem Computer nutzen kannst. Die Installation ist kinderleicht:

- Öffne ollama.com in deinem Browser

- Klicke auf Download

- Wähle dein Betriebssystem (Windows, Mac oder Linux)

- Installiere die Anwendung wie gewohnt

Sobald Ollama installiert ist, öffnet sich eine Benutzeroberfläche, die ChatGPT zum Verwechseln ähnlich sieht. Du kannst direkt deine erste Frage stellen – zum Beispiel: "Was ist ein lokales LLM?"

Wenn du im Terminal ollama list eingibst, siehst du alle Modelle, die du bereits installiert hast. Auf der Ollama-Website unter "Models" findest du hunderte verfügbare KI-Modelle zum Download.

Das richtige Modell auswählen – aber wie?

Hier wird es spannend, denn nicht jedes Modell läuft auf jedem Computer. Die verschiedenen Modelle haben unterschiedlich viele Parameter – und das macht den entscheidenden Unterschied.

Du findest Modelle mit:

- 1,7 Milliarden Parametern

- 3 Milliarden Parametern

- 7 Milliarden Parametern

- 70 Milliarden Parametern

- Und viele mehr

Als Faustregel gilt: Du solltest mindestens 8 GB RAM haben, um ein 7-Milliarden-Parameter-Modell laufen zu lassen. Aber Achtung – das ist nur ein grober Richtwert. Um wirklich professionell mit lokalen LLMs zu arbeiten, solltest du die Grundlagen verstehen.

Wie KI wirklich funktioniert: Die Grundlagen

Neuronale Netze: Von Gehirnen inspiriert

KI-Modelle basieren auf künstlichen neuronalen Netzen – inspiriert von unserem menschlichen Gehirn. Unser Gehirn besteht aus Milliarden von Neuronen, die über Synapsen Informationen übermitteln. Wenn du gerade erkennst, dass etwas grün ist, feuern in deinem Kopf unzählige Neuronen und übertragen Signale.

Künstliche neuronale Netze funktionieren ähnlich, arbeiten aber ausschließlich mit Zahlen. Diese Zahlen nennt man Parameter. Ein einfaches neuronales Netz besteht aus:

- Input Layer: Nimmt Informationen auf (z. B. ein Bild oder Text)

- Hidden Layer: Verarbeitet die Daten, erkennt Muster

- Output Layer: Gibt die Antwort aus

Zwischen den Neuronen gibt es Gewichte und Biases – das sind die Parameter. Je mehr Parameter ein Modell hat, desto komplexer sind die Muster, die es erkennen kann.

Parameter im Vergleich

Um das Ganze greifbarer zu machen, hier ein Vergleich mit biologischen Gehirnen:

- Maus: etwa 500 Millionen Synapsen

- Katze: über 1 Milliarde Synapsen

- Hund: etwa 2,5 Milliarden Synapsen

- Mensch: 100 bis 500 Billionen Synapsen

Aktuelle KI-Modelle liegen bei etwa 1 bis 2 Billionen Parametern – deutlich intelligenter als Hunde, aber noch weit entfernt von menschlicher Intelligenz. Dennoch sind sie bereits heute beeindruckend leistungsfähig.

Tokenisierung: Wie KI Text versteht

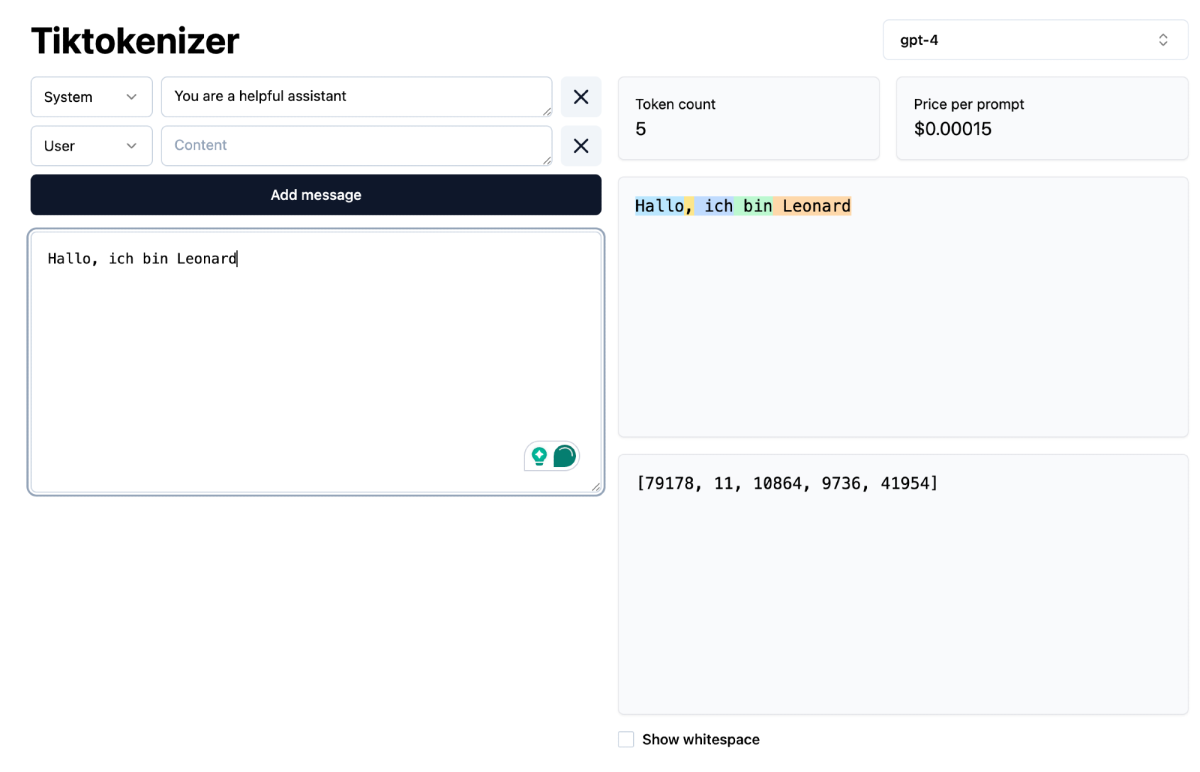

Bei Bildern ist klar, dass sie aus Pixeln (also Zahlen) bestehen. Aber wie verarbeitet KI Text? Durch Tokenisierung. Ein Token ist ungefähr ein Wort – aber nicht ganz:

- "Hallo, ich bin Leonard" = 4 Token (kommt auf das Modell an wie viele Tokens gezählt werden!)

- "Hallo, ich bin Leonard " (mit Leerzeichen am Ende) = 5 Token

KI liest keine Sätze wie wir Menschen. Sie zerlegt Text in Tokens und verarbeitet diese als numerische Einheiten. Das ist die Grundlage jeder Antwort. Quelle: https://tiktokenizer.chatgptcn.com/

Jedes Token wird in einen Zahlenwert umgewandelt, den das neuronale Netz verarbeiten kann. Das sogenannte Kontext-Fenster gibt an, wie viele Tokens ein Modell gleichzeitig verarbeiten kann – ein wichtiger Wert bei der Modellauswahl.

Hardware-Anforderungen: Was du wirklich brauchst

Das Problem mit der Modellgröße

Neuronale Netze speichern ihre Parameter mit einer Präzision von 32 Bit – das ist der Goldstandard. Das Problem: Ein 7-Milliarden-Parameter-Modell benötigt bei 4 Bytes pro Parameter etwa 28 GB Speicher. Das würde selbst moderne Gaming-PCs überfordern.

Selbst die kleinere Version des viralen DeepSeek-Modells mit 7 Milliarden Parametern bräuchte mindestens eine leistungsstarke Nvidia RTX 4090, um überhaupt zu laufen. Für die meisten Computer ist das schlichtweg zu viel.

Die Lösung: Quantisierung

Quantisierung bedeutet, die Präzision des Modells zu verringern, ohne dabei viel Leistung zu verlieren. Statt mit 32 Bit zu speichern, reduzieren wir auf 16, 8 oder sogar 4 Bit.

Stell dir das so vor: Wenn dich jemand nach der Uhrzeit fragt, sagst du auch nicht "10 Uhr, 21 Minuten, 35 Sekunden und 42 Millisekunden". Du sagst einfach "10:20 Uhr". Es ist nicht 100 % präzise, aber völlig ausreichend.

Genau dieses Prinzip nutzen quantisierte Modelle. Die wichtigsten Stufen:

- 16-Bit: Sehr hohe Qualität, aber immer noch ressourcenintensiv

- 8-Bit: Guter Kompromiss zwischen Qualität und Größe

- 4-Bit: Deutlich kleiner, minimaler Qualitätsverlust

Durch Quantisierung kannst du auch große Modelle auf durchschnittlicher Hardware laufen lassen – der Gamechanger für private KI.

Deine Chance, JETZT zu handeln!

Private KI ist keine Zukunftsmusik mehr – sie ist jetzt verfügbar, einfach einzurichten und bietet massive Vorteile gegenüber Cloud-Lösungen. Du sparst Tausende Euro, schützt deine Daten und bleibst rechtlich auf der sicheren Seite. Für Unternehmen sind Corporate LLMs nicht mehr optional, sondern werden zunehmend zur Pflicht.

Der Markt steht noch am Anfang. Die meisten Unternehmen suchen händeringend nach sicheren, kostengünstigen KI-Lösungen – und wissen nicht, dass die Antwort bereits auf ihrem eigenen Server liegen kann. Wer jetzt das Wissen aufbaut und lokale LLMs implementiert, verschafft sich einen enormen Wettbewerbsvorteil.

Dein nächster Schritt: Installiere Ollama, lade dein erstes Modell herunter und experimentiere. Stelle Fragen, teste verschiedene Modelle, verstehe die Unterschiede. Die Technologie ist da – du musst sie nur nutzen. Bei Rückfragen oder wenn Hilfe im Bereich KI Security und Implementierung benötigt wird, steht dir unser Expertenteam jederzeit zur Verfügung: https://apex-consulting.ai/