Agentic Engineering: Deine Lebensversicherung für das Agentur-Geschäft 2026.

Agentic Engineering: Dein Airbag, wenn die KI halluziniert.

Du hast einen KI-Agenten implementiert, er läuft seit drei Wochen ohne Probleme, und plötzlich schreibt er einem Kunden eine völlig absurde E-Mail? Willkommen in der Realität probabilistischer Systeme. Das Problem ist nicht, dass die Technologie versagt – sondern dass viele Unternehmen und Agenturen KI-Agenten immer noch wie klassische Software behandeln. Ein teurer Irrtum, der dich nicht nur Geld, sondern auch das Vertrauen deiner Kunden kosten kann. Denn wer KI-Systeme wie Excel-Makros einsetzt, spielt Russisch Roulette mit seiner operativen Exzellenz.

Der gefährliche Unterschied: Determinismus vs. Probabilistik

Klassische Automatisierung ist deterministisch. Das bedeutet: Du gibst Input A, und du bekommst garantiert Output B. Immer. Ohne Überraschungen. Ein Zapier-Workflow, ein Skript, eine Excel-Formel – sie alle folgen einer starren Logik. Sie sind langweilig, aber verlässlich.

KI-Agenten funktionieren völlig anders. Sie sind probabilistisch. Das heißt, sie berechnen Wahrscheinlichkeiten und treffen Entscheidungen auf Basis von Mustern, die sie in riesigen Datenmengen gelernt haben. Und genau wie ein menschlicher Mitarbeiter können sie bei identischem Input heute brilliant antworten – und morgen kompletten Unsinn produzieren.

Warum das so gefährlich ist

Ein klassisches Programm stürzt ab, wenn etwas schiefgeht. Es wirft eine Fehlermeldung, stoppt den Prozess, und du weißt sofort: Hier ist etwas faul. Ein KI-Agent hingegen stürzt nicht ab. Er halluziniert. Er erfindet Rabatte, verspricht unmögliche Lieferzeiten oder formuliert im schlimmsten Fall eine völlig unangemessene Antwort – und das alles mit der Selbstsicherheit eines Experten.

Das ist das wahre Risiko sogenannter "Agentic Systems": Sie scheitern lautlos und richten dabei maximalen Schaden an, bevor du überhaupt merkst, dass etwas nicht stimmt.

Das Happy-Path-Problem: Warum die meisten Implementierungen scheitern

Die meisten Agenturen und Unternehmen bauen ihre KI-Agenten nach dem "Happy Path"-Prinzip: Sie testen den Agenten dreimal unter idealen Bedingungen, er funktioniert, und schwupps – ab in die Produktion. Das ist nicht nur naiv, sondern fahrlässig.

Professionelles Agentic Engineering beginnt genau dort, wo das Prompting aufhört. Es geht nicht nur darum, der KI zu sagen, was sie tun soll. Es geht darum, Systeme zu bauen, die verhindern, dass dein Agent Amok läuft, wenn er mal einen schlechten Tag hat.

Technologische Leitplanken statt blindem Vertrauen

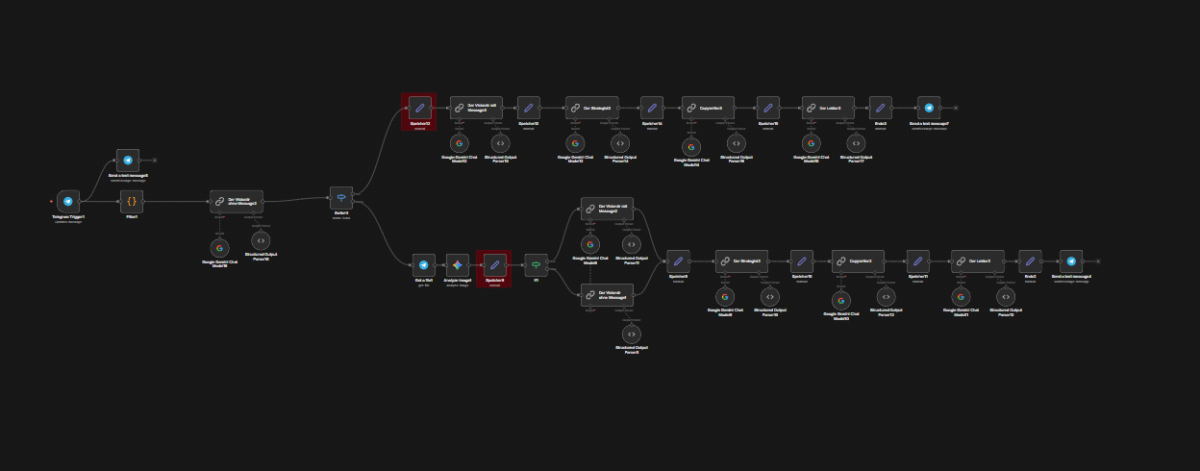

Intelligentes Dispatching: Erst wird analysiert, dann gehandelt. Dieser Workflow entscheidet basierend auf dem Inhalt, welcher Spezialisten-Agent übernimmt.

Ein robuster KI-Agent darf niemals einfach "raten", wenn er sich unsicher ist. Stattdessen braucht er:

- Definierte Rücksprungpunkte: Wenn die Wahrscheinlichkeit für eine korrekte Antwort unter einen bestimmten Schwellenwert fällt, muss der Agent eskalieren.

- Transparente Unwissenheit: Ein guter Agent kann sagen "Ich weiß es nicht, ich hole einen Menschen" – anstatt einfach irgendetwas zu erfinden.

- Fallback-Prozesse: Deterministische Backup-Szenarien für kritische Situationen, in denen keine Unsicherheit toleriert werden kann.

Ein Agent, der seine eigene Unsicherheit nicht erkennen und kommunizieren kann, ist keine Automatisierung – er ist eine Zeitbombe.

Überwachte Autonomie: Das Prinzip der Zukunft

Wir müssen aufhören, KI-Agenten als "Fire and Forget"-Lösungen zu verkaufen. Ein KI-Agent in der Produktion ist keine fertige Software, sondern eine Lernumgebung, die kontinuierlich überwacht werden muss. Und zwar nicht durch manuelle Stichproben, sondern durch automatisierte Evaluierungen – sogenannte Evals.

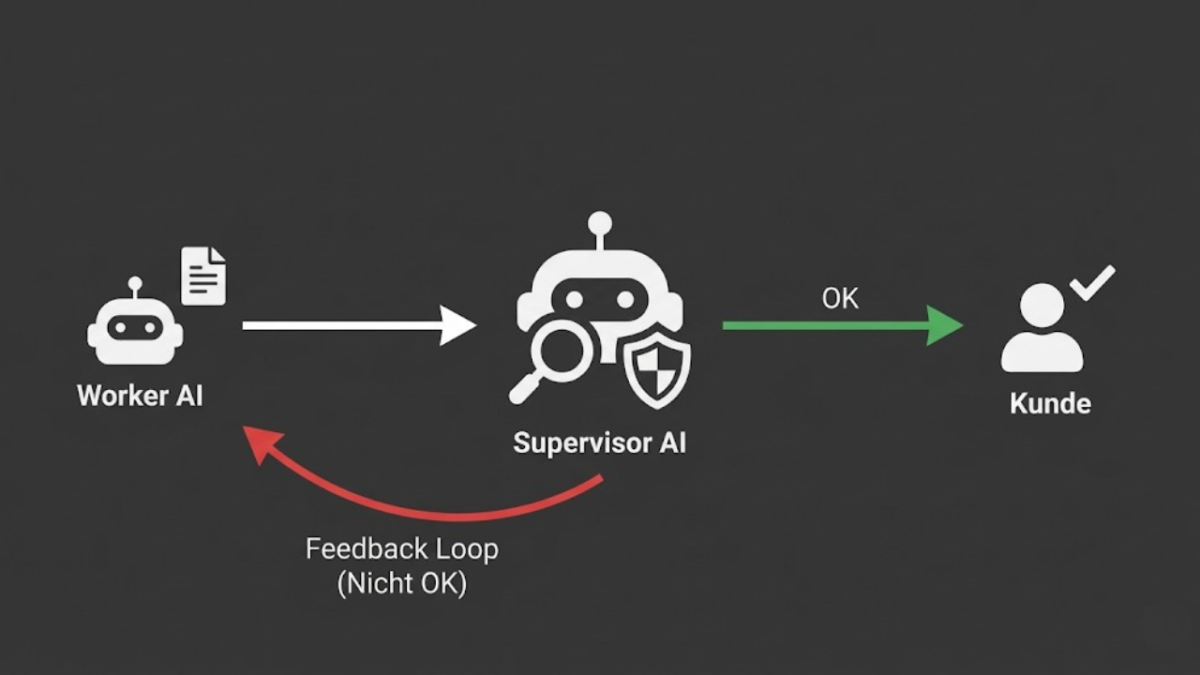

Die Zukunft gehört Systemen, in denen eine zweite, kritische KI die Arbeit der ersten KI überprüft, bevor sie das Haus verlässt. Diese Supervisor-Modelle prüfen Outputs auf:

- Faktentreue

- Tonalität

- Logik und Konsistenz

Erst wenn all diese Checks bestanden sind, erreicht die Antwort den Kunden. Das ist der Kern von Agentic Engineering: Wir vertrauen der Wahrscheinlichkeit nicht, wir managen sie.

Vertrauen ist gut, Kontrolle ist besser: So prüft eine "Supervisor-KI" die Ergebnisse, bevor sie dein Haus verlassen.

Was du jetzt tun solltest

Bevor du versuchst, komplexe, autonome Agenten zu bauen, die eigenständig Entscheidungen treffen, solltest du erst einmal lernen, stabile, deterministische Workflows zu beherrschen.

Ein simpler, aber zuverlässiger Prozess ist tausendmal wertvoller als ein "intelligenter" Agent, der dein Business am Dienstag lahmlegt, weil er die Realität falsch berechnet hat.

Do's:

- Baue Schwellenwerte ein, ab denen der Agent eskaliert

- Implementiere Supervisor-Modelle zur Qualitätskontrolle

- Teste nicht nur den Happy Path, sondern bewusst Edge Cases und Fehlszenarien

- Behandle KI-Agenten wie Mitarbeiter: Sie brauchen Einarbeitung, Feedback und Überwachung

Don'ts:

- Gehe nicht davon aus, dass ein Agent nach drei erfolgreichen Tests produktionsreif ist

- Lass KI niemals unkontrolliert mit Kunden kommunizieren

- Verwechsle "autonom" nicht mit "unkontrolliert"

- Unterschätze nicht die stillen Risiken von Halluzinationen

Fazit: Verlässlichkeit schlägt Experimentierfreude

KI-Agenten sind keine Software im klassischen Sinne. Sie sind probabilistische Systeme, die wie Menschen mal besser, mal schlechter performen – nur dass sie ihre Fehler mit absoluter Überzeugung präsentieren. Wer das nicht versteht und managt, baut keine Automatisierung, sondern ein Risiko.

Die wichtigste Erkenntnis: Ein KI-Agent, der seine eigene Unwissenheit nicht erkennen kann, ist gefährlicher als kein Agent. Wer 2026 noch relevant sein will, muss Systeme bauen, die Wahrscheinlichkeiten nicht blind vertrauen, sondern sie aktiv überwachen und kontrollieren.

Am Ende bezahlen Kunden nicht für deine Experimentierfreudigkeit, sondern für Verlässlichkeit. Wenn du diese Disziplin nicht aufbringen kannst oder willst, bleib lieber bei Excel. Aber wenn du bereit bist, KI-Agenten richtig zu implementieren – mit Leitplanken, Evals und Supervisor-Modellen – dann hast du die Chance, echte operative Exzellenz zu erreichen.

Dein Takeaway: Beobachte deine KI-Agenten in den nächsten Wochen bewusst. Nicht nur, wenn sie funktionieren, sondern vor allem, wenn sie unsicher sind. Bau Eskalationsmechanismen ein, bevor das erste Problem beim Kunden landet. Denn der beste Agent ist nicht der intelligenteste – sondern der, der weiß, wann er um Hilfe bitten muss.